Подразделение Kandinsky выложило в open source семейство токенизаторов KVAE-2.0, которое можно использовать для создания моделей генерации изображений и видео. В компании считают, что это поможет разработчикам обучать такие системы быстрее, дешевле и без опоры на зарубежные решения.

«Сбер» опубликовал семейство токенизаторов KVAE-2.0 — это инструменты, которые сжимают визуальные данные в более удобный для нейросетей формат. На их основе можно строить модели для генерации изображений и видео.

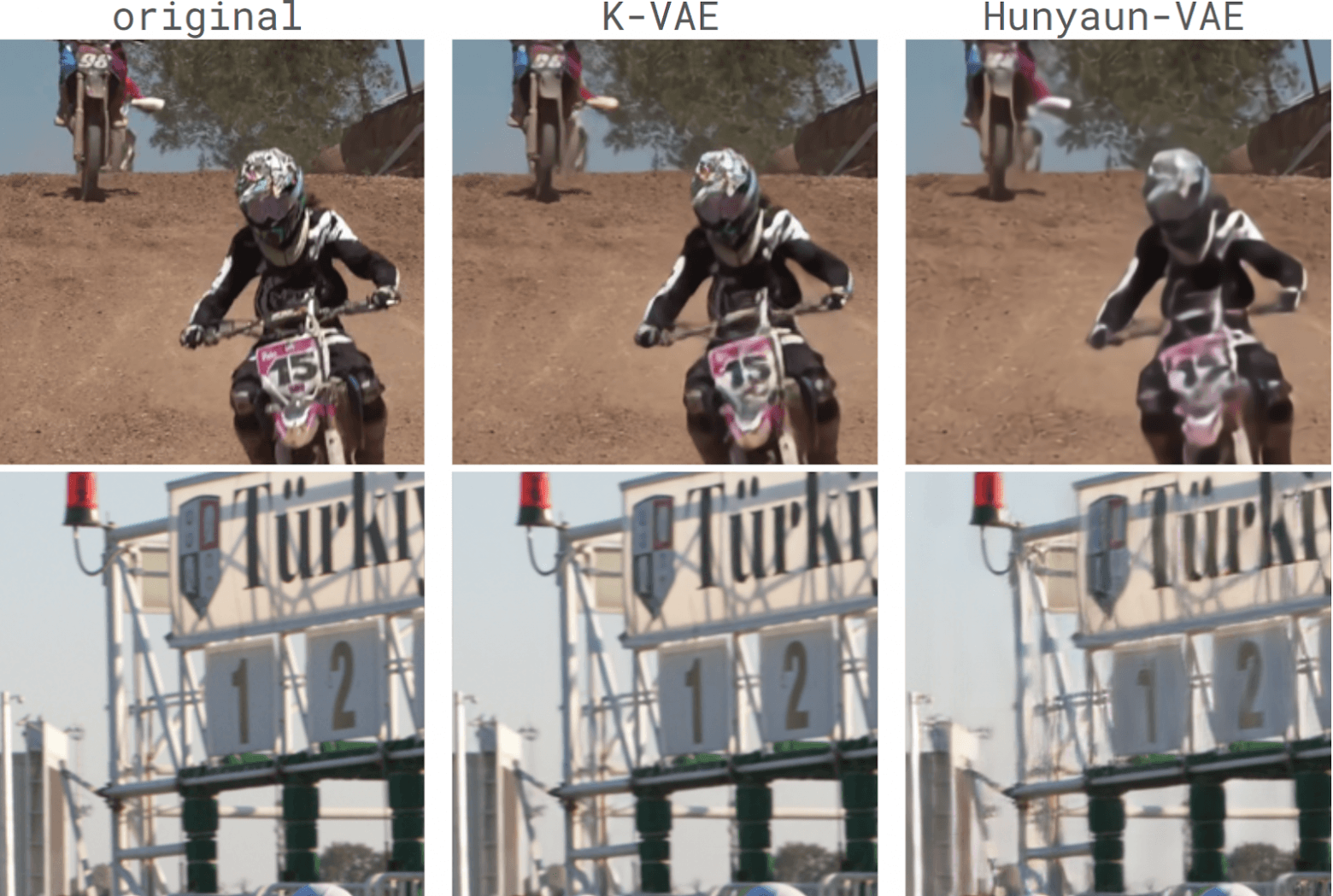

В компании сравнили KVAE-2.0 с аналогичными компонентами внутри китайских моделей Hunyuan Video и Wan 2.2 от Alibaba. По словам разработчиков, решение от «Сбера» лучше восстанавливает исходное видео, аккуратнее передаёт лица и текст, а также увереннее работает с надписями на русском языке.

Руководитель проекта Kandinsky Денис Димитров говорит, что такой инструмент должен упростить жизнь стартапам и исследовательским командам: с ним можно будет быстрее и дешевле обучать собственные видеомодели с нуля, не полагаясь на зарубежные токенизаторы.

Код и веса KVAE-2.0 выложили на GitHub и Hugging Face под лицензией MIT. Это значит, что использовать разработку можно не только в исследованиях, но и в коммерческих проектах.