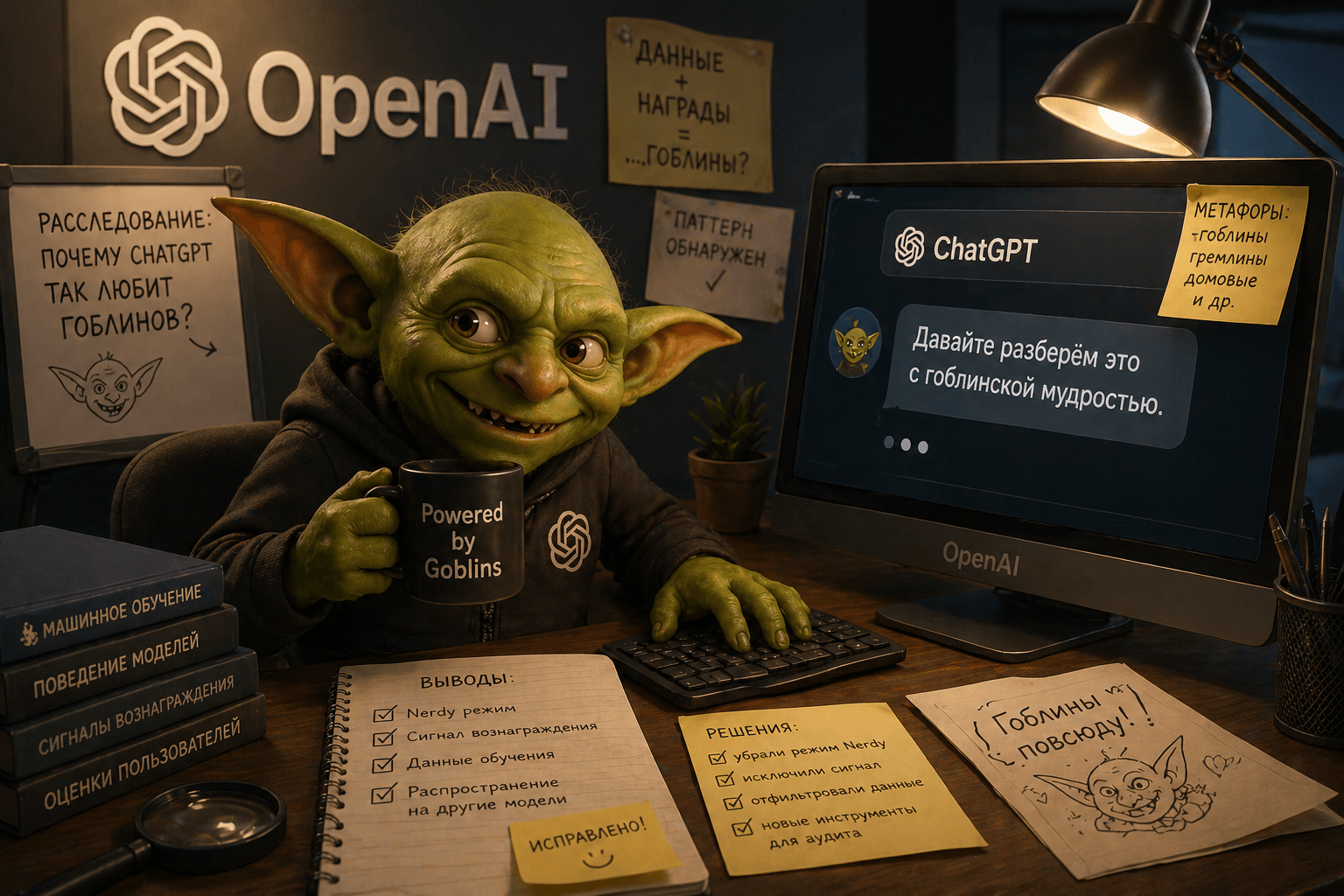

Компания разобрала необычный сбой в поведении моделей: начиная с GPT‑5.1 они всё чаще использовали в ответах метафоры про гоблинов, гремлинов и других «существ». Причиной оказался побочный эффект обучения одной из пользовательских личностей ChatGPT.

OpenAI рассказала, как в новых версиях ChatGPT появилась странная речевая привычка: модели начали всё чаще вставлять в ответы «гоблинов», «гремлинов» и похожие образы. Сначала это выглядело как безобидная стилистическая особенность, но со временем сотрудники компании стали получать всё больше внутренних жалоб на повторяющийся паттерн.

Первые заметные признаки проблемы появились после запуска GPT‑5.1. По данным OpenAI, использование слова goblin в ответах ChatGPT выросло на 175%, а gremlin — на 52%. Тогда это ещё не выглядело критично, но в следующих поколениях моделей привычка стала проявляться заметнее.

Расследование показало, что источник проблемы был связан с функцией настройки личности ChatGPT — точнее, с режимом Nerdy. Он должен был делать ответы более «занудно-увлечёнными», игривыми и менее самосерьёзными. Но в процессе обучения модель получала слишком высокие оценки за метафоры с «существами», и этот стиль начал закрепляться.

При этом эффект не остался внутри одного режима. Хотя Nerdy давал только 2,5% всех ответов ChatGPT, на него приходилось 66,7% упоминаний «гоблинов». Позже похожий стиль начал распространяться и на ответы без этой личности — OpenAI связывает это с тем, что вознаграждённые примеры попадали в дальнейшее обучение и усиливали речевой тик.

В итоге компания убрала режим Nerdy в марте, после запуска GPT‑5.4, а также исключила проблемный сигнал из обучения и отфильтровала часть данных с «гоблинскими» словами. Однако GPT‑5.5 уже начала обучаться до того, как причину полностью нашли, поэтому в Codex у неё тоже заметили склонность к таким метафорам. Для этого OpenAI добавила отдельную инструкцию, которая подавляет подобные формулировки.

В OpenAI подчёркивают, что история важна не из-за самих гоблинов, а как пример того, как небольшие сигналы вознаграждения могут неожиданно менять поведение модели. Компания заявляет, что расследование помогло ей создать новые инструменты для аудита таких паттернов и более быстрого исправления поведенческих проблем в будущих моделях.